Он нам и не нужен, ваш интеллект

Индустрия искусственного интеллекта столкнулась с барьером, который невозможно преодолеть за счет денег или выпуска новых поколений чипов. Глобальный дефицит энергосетей, нехватка комплектующих и сопротивление локальных сообществ привели к тому, что строительство центров обработки данных (ЦОД) превратилось в одну из самых сложных логистических и политических задач для технологического сектора.

В чем принципиальное отличие устройства ИИ-дата-центров от классических ЦОД, почему индустрия стала еще больше зависеть от Китая и как люди свергают местную власть в попытках защитить себя от шума и экологической катастрофы — в новом материале ForkLog.

Специфика архитектуры

Традиционные дата-центры, которые обслуживали интернет-экономику последние двадцать лет, принципиально отличаются от архитектуры, требуемой для работы с большими языковыми моделями.

Классический ЦОД ориентирован на CPU и потребляет в среднем от 5 до 10 кВт электроэнергии на одну серверную стойку, тогда как на GPU под ИИ-задачи приходится примерно в 10 раз больше затрат. Стойки для машинного обучения с ускорителями класса Nvidia H100 или B200 требуют от 40 до 120 кВт на единицу. Разница в плотности энергопотребления влияет на базовую физику объектов.

Кластер из десятков тысяч GPU в пиковой нагрузке потребляет электричество на уровне небольшого промышленного города. Проблема в том, что распределительные сети и подстанции обычно не проектируются с учетом подобных скачков потребления на изолированных участках.

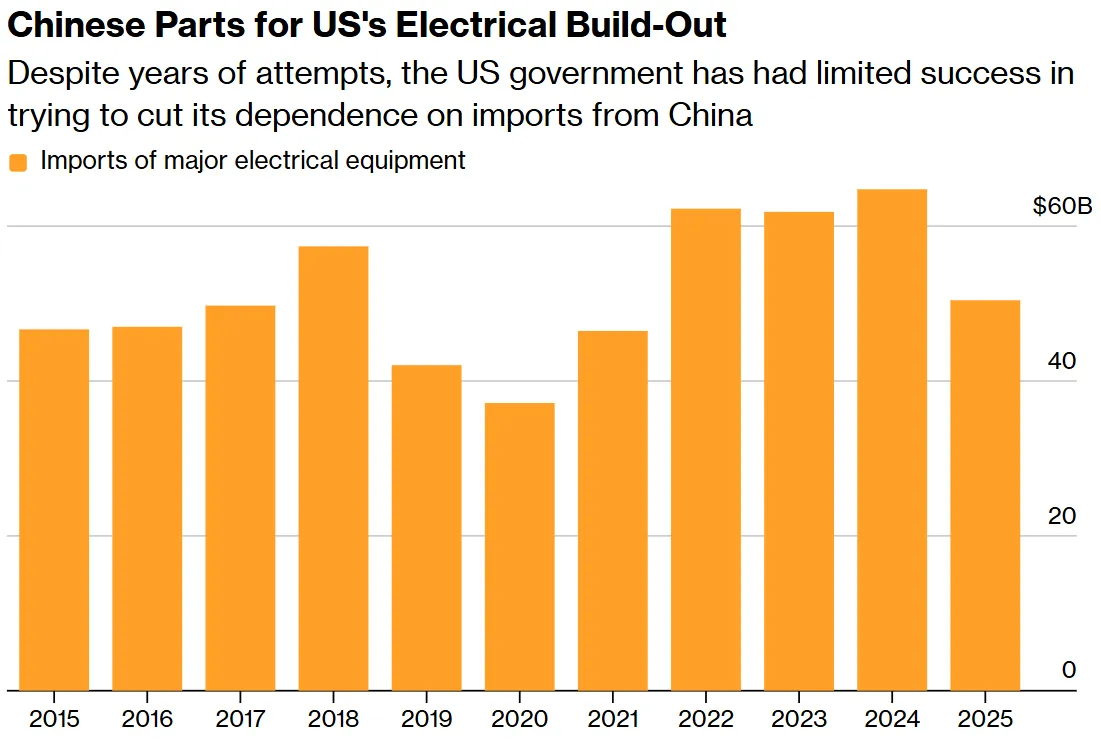

Аппетиты лидеров ИИ-индустрии опустошили запасы критически важных комплектующих для подвода электроэнергии: высоковольтных трансформаторов, генераторов и аккумуляторов для систем бесперебойного питания. Производственные мощности в США и Европе не справляются с объемом заказов. В результате очередь на поставку промышленных трансформаторов, преимущественно из Китая, увеличилась с одного–двух до трех–пяти лет.

Еще одна проблема — отвод тепла. Воздушное охлаждение не справляется с плотностью ИИ-серверов. Индустрия вынуждена переходить на жидкостные системы охлаждения вроде Direct-to-Chip или иммерсионных ванн. Они требуют миллионы литров очищенной воды и несут угрозу регионам, особенно в засушливых климатических зонах.

По данным, которые приводит нидерландский специалист Алекс де Врис-Гао, в 2025 году системы ИИ во всем мире потребили около 765 млрд литров воды. Для экономии природного ресурса разработчики совершенствуют механизмы. Вместо традиционных градирен, где вода испаряется в атмосферу, новые дата-центры все чаще оснащают системами замкнутого контура. В них вода циркулирует по трубам, забирает тепло, охлаждается в радиаторах и возвращается обратно к серверам практически без потери объема. Однако темпы внедрения этой технологии сильно уступают скорости создания новых ЦОД.

Практически у звездных врат

Беспрецедентный бюджет, поддержка первых лиц государства и статус главного ИИ-альянса десятилетия. На старте у проекта Stargate было все — по крайней мере на словах.

Stargate — амбициозная инициатива стоимостью $500 млрд, которую президент США Дональд Трамп анонсировал в январе 2025 года в рамках национальной кампании по удержанию технологического доминирования. Совместное предприятие OpenAI, SoftBank и Oracle должно было стать главным драйвером расширения инфраструктуры ИИ-дата-центров.

Через год после громкого анонса в Белом доме совместное предприятие так и не обзавелось полноценной командой и не заключило ни одной крупной сделки на строительство от своего имени.

Ситуация усугубилась и на финансовых рынках. Банк JPMorgan Chase, который должен был организовать размещение долговых обязательств Stargate на $38 млрд, столкнулся с сомнениями инвесторов в окупаемости предприятия.

Глава OpenAI Сэм Альтман и основатель SoftBank Масайоси Сон разошлись во взглядах на базовые вещи: где именно строить объекты и кто будет их контролировать. С сентября по октябрь 2025 года топ-менеджеры Stargate неоднократно летали в Токио для тяжелых переговоров с Соном, но так и не смогли решить, кто выступит владельцем платформы для флагманского кампуса в Абилине, штат Техас.

OpenAI рассматривала самостоятельную реализацию проекта, однако кредиторы отказались выделять компании средства без четкого плана выхода на прибыль.

Stargate отказалась от амбициозных целей и освободила площадку под 900 МВт, сохранив базовые мощности в Техасе, нацеленные на 1,2 ГВт в будущем. Партнеры сместили фокус расширения, и в апреле 2026 года девелопер Related Digital совместно с Oracle привлек $16 млрд долгового и акционерного финансирования для строительства нового мега-дата-центра в Мичигане под нужды OpenAI.

Тем временем неуверенностью Stargate воспользовались конкуренты. В конце марта 2026 года вакантные 900 МВт перехватила Microsoft, став новым партнером Crusoe Energy по расширению кампуса в Абилине. Модернизация позволит довести общую мощность этого объекта до 2,1 ГВт к середине 2027 года с использованием GPU Nvidia.

Люди против

Дата-центры больше не воспринимаются как однозначный драйвер экономики — они создают минимум рабочих мест после завершения стройки, но при этом нагружают сети, потребляют воду и генерируют постоянный шум.

В апреле 2026 года жители Фестуса, штат Миссури, выступили с протестом против строительства ЦОД стоимостью $6 млрд. Местные жители добились отстранения четырех из восьми членов городского совета, а также запустили петицию об увольнении оставшихся, включая мэра.

9 апреля жители подали иск против города, утверждая, что власти Фестуса не предоставили общественности достаточно времени для ознакомления с предложением перед принятием решения и приняли незаконные решения по смене зонирования для этого проекта. В иске также утверждается, что город участвовал в частных встречах, касающихся проекта, вместо публичных.

Одобренный проект для неназванного застройщика должен занять 360 акров земли.

За последние несколько месяцев в США произошла череда подобных событий:

- в феврале 2026 года городской совет Нью-Брансуика (Нью-Джерси) под давлением общественности отклонил сделку по строительству ЦОД, решив вместо этого использовать 27 000 квадратных футов недвижимости для строительства общественного парка;

- в том же месяце предложение о присоединении земель к черте города Фористолл (Миссури) встретило сопротивление граждан из-за опасений, что земля будет использована для строительства дата-центра. В итоге решение изменили и сохранили за территорией статус сельскохозяйственных угодий;

- в сентябре 2025 года округ Принс-Джордж (Мэриленд) приостановил проекты создания дата-центров после протестов местных жителей и сформировал целевую группу для изучения рисков;

- в Сент-Чарльзе (Миссури), который находится менее чем в часе езды от Фестуса, предпринимаются попытки навсегда запретить строительство дата-центров после введения моратория в августе 2025 года.

A data center in New Brunswick was canceled tonight when hundreds of residents showed up. When fight big tech and private equity we win. pic.twitter.com/doZ63Pdwue

— Ben Dziobek (@BenDziobek) February 19, 2026

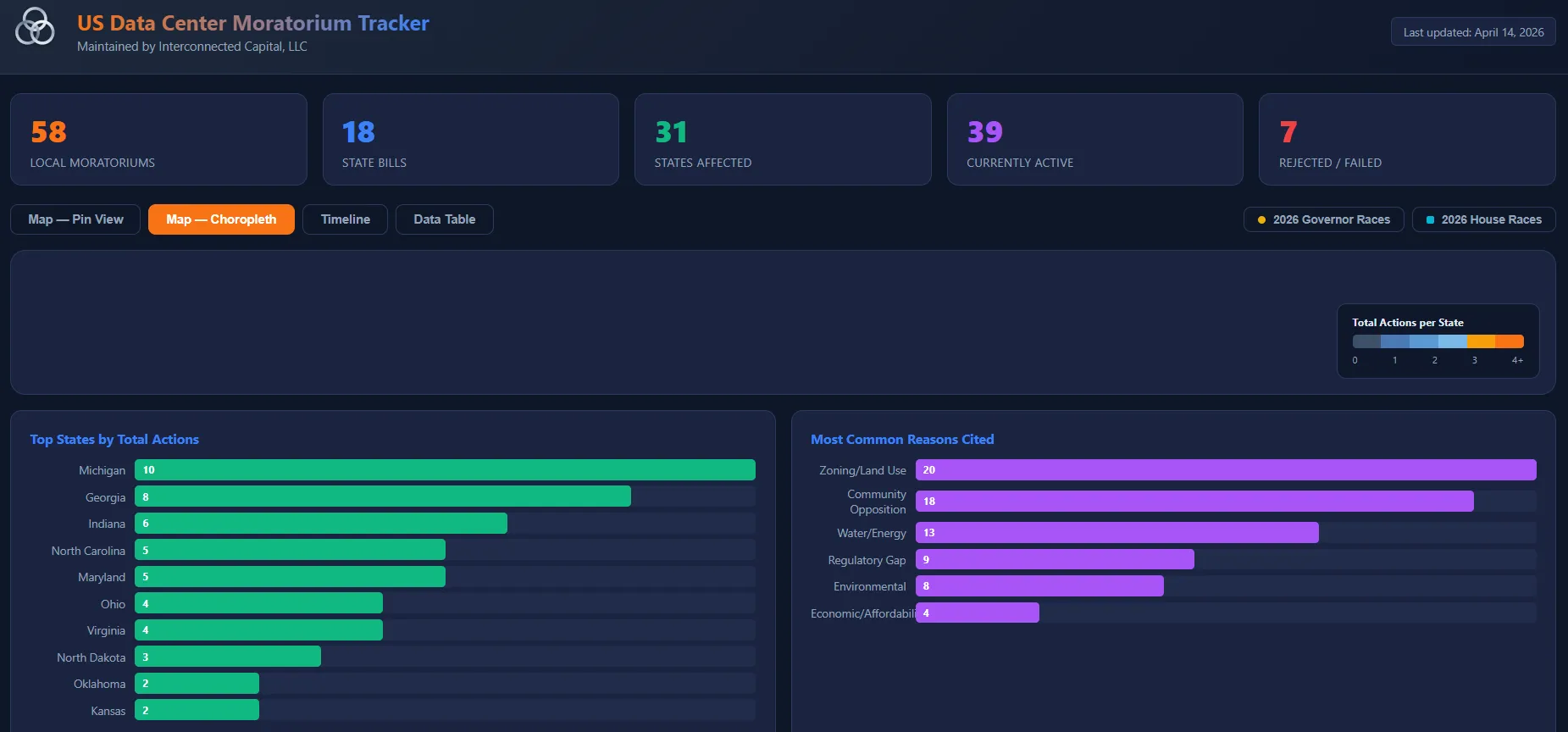

Растущий тренд на борьбу со строительством вычислительных ферм усилил спрос на прозрачность и доступ к данным в реальном времени. Команда «Трекера мораториев на строительство дата-центров в США» ищет компании, стоящие за неназванными участниками сделки, а также отслеживает все локации, где власти официально ввели временный запрет на строительство новых ЦОД.

Согласно дашборду, на 14 апреля 2026 года в США действуют 58 мораториев.

Что ж, тогда в космос

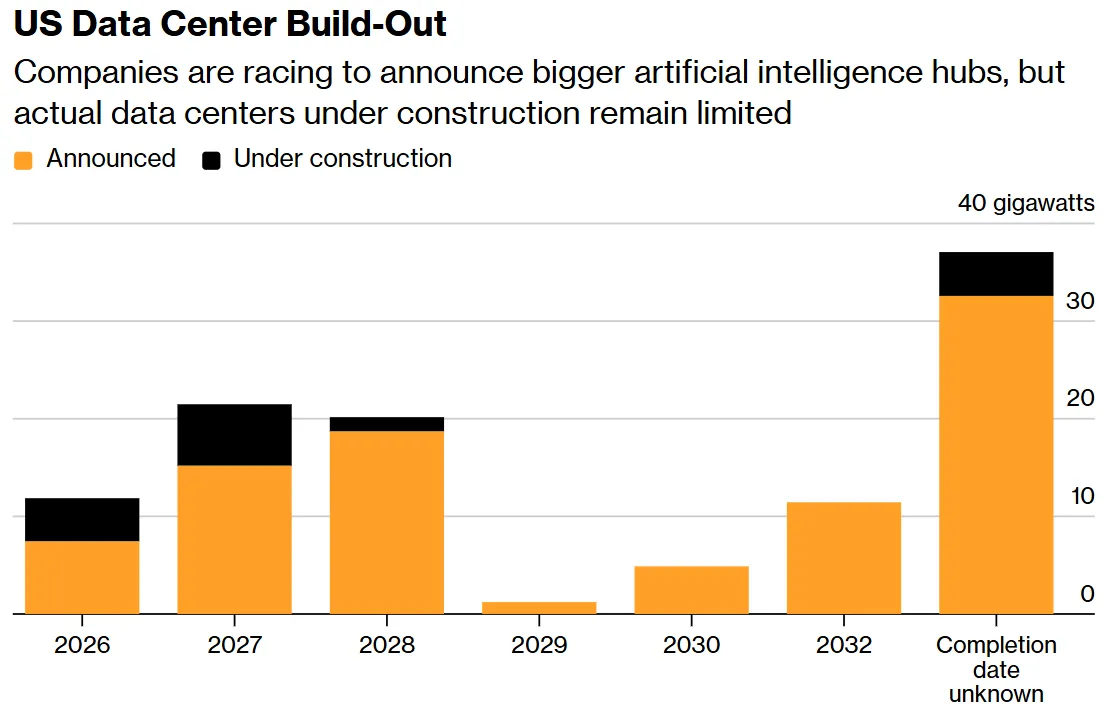

Дефицит энергии, задержки комплектующих и протесты населения привели к стагнации отрасли.

По данным Bloomberg, строительство около половины всех запланированных дата-центров в США было либо отложено на неопределенный срок, либо полностью отменено. Из прогнозируемых мощностей в активной фазе строительства находится менее трети.

Технологические гиганты и независимые разработчики стремятся найти альтернативные способы размещения вычислительных мощностей — от дна океана до космоса.

В период 2014—2024 годов Microsoft исследовала погружение под воду герметичных серверных капсул. Последний крупный тест проекта Project Natick прошел у побережья Оркнейских островов (Шотландия) с 2018 по 2020 год. На глубину около 35 метров опустили капсулу с двумя стойками из 864 серверов.

За два года под водой вышли из строя всего шесть вычислительных единиц. Для сравнения: в контрольной группе на суше сломалось в восемь раз больше оборудования. Это объяснили тем, что внутри капсулы был инертный азот, отсутствовали перепады температур и человеческий фактор — частая причина поломок.

По словам исследователей, океан обеспечил бесплатный и бесконечный отвод тепла, и, вопреки опасениям, дата-центр «не навредил экосистеме». Более того, вокруг капсулы образовался искусственный риф, привлекший рыб.

Несмотря на успех, проект закрыли по причинам неприменимости к ИИ-направлению и проблемам с логистикой. Для любого физического вмешательства необходимо подгонять корабли, поднимать многотонную капсулу со дна, а затем заново ее герметизировать.

Как же с этой задачей справятся в космосе? В конце 2025 года эксперты исследовательской группы 33FG подсчитали, что к 2030 году ИИ-вычисления на орбите будут дешевле, чем на Земле.

В феврале SpaceX подала в Федеральную комиссию по связи США запрос на разрешение вывести на орбиту группу из 1 млн спутников для центров обработки данных. Проект предполагает создание сети ЦОД, связанных лазерными каналами.

Логика космических дата-центров опирается на два фактора: доступ к круглосуточной солнечной энергии и низким температурам для идеального естественного охлаждения.

Однако концепция сталкивается с жесткими коммерческими и физическими барьерами. Руководство SpaceX предупредило о рисках нерентабельности таких проектов на текущем этапе.

Основные трудности концепции:

- стоимость вывода. Несмотря на снижение цены за килограмм полезной нагрузки, отправка тяжелых серверных стоек с вольфрамовой защитой от космической радиации остается экстремально дорогой;

- задержка сигнала. Для инференса (работы готовой нейросети в реальном времени с пользователем) важны миллисекунды. Передача огромных массивов данных с Земли на орбиту и обратно вносит задержки, делающие систему непригодной для ряда задач. Такие ЦОД могут подойти только для асинхронного обучения моделей;

- обслуживание. Замена вышедшего из строя GPU в космосе невозможна. Срок жизни оборудования строго ограничен его отказоустойчивостью в условиях радиации.

Другие проекты также активно участвуют в космической инициативе: Google сообщила о стремлении создать систему спутников на околоземной орбите для получения солнечной энергии и питания дата-центров, Nvidia анонсировала создание вычислительной платформы для космических ЦОД.

В 2026 году стартап Aetherflux из Калифорнии планирует вывести на орбиту солнечные мини-фермы в виде спутников для передачи энергии из космоса на Землю с помощью лазеров.

27 апреля 2026 года Meta договорилась о поставках 1ГВт из космоса для своих дата-центров с другим стартапом. По заявлению разработчика внеземной электростанции Overview Energy, первая орбитальная демонстрация системы ожидается в 2028 году, а коммерческие поставки — в 2030 году.

Развитие ИИ-инфраструктуры столкнулось с физическими и административными ограничениями. Высокое энергопотребление новых GPU-кластеров, потребность в водных ресурсах для охлаждения и нагрузка на локальные электросети привели к пересмотру отношения к дата-центрам со стороны населения и муниципалитетов. В результате масштабирование наземных вычислительных мощностей превратилось из вопроса доступного капитала в сложную логистическую и социальную задачу.

Инициативы по созданию орбитальных дата-центров, несмотря на текущую дороговизну и барьеры в обслуживании, становятся прагматичным ответом на наземный кризис инфраструктуры. В ближайшие годы способность компаний решить проблему физического размещения оборудования определит темпы дальнейшего развития вычислительных систем.